P(x) = ax²+bx+c, Delta positif

| \[\begin{align*} I= \int \frac{1}{x^2-5x+6}dx \end{align*} \text{ et } \Delta \gt 0\] | ||||||

|

|

| Généralisation: \[\begin{align*} & I = \int \frac{1}{ax²+bx+c}dx \end{align*}\] | ||||

|

|

10 Techniques d'intégration

\(\begin{align*} I =\int f(x)dx \end{align*}\)

\(\begin{align*} I = \overbrace{\int}^{\text{Symbole} \\ \text{intégration}} \underbrace{f(x)}_{\text{intégrande}} \overbrace{dx}^{\text{variable} \\ \text{d'intégration}} \end{align*}\)

Nous recherchons une fonction \(F(x)\) dont la dérivée est égale à l 'intégrande \(f(x)\). Cette fonction \(F(x)\) est une des primitives de \(f(x)\).

La dérivée de \(F(x) \) est égale à \(f(x)\). Mais on remarque que la fonction \(F(x) + C\), avec \(C=\)constante, \(C \in \mathbb R\) est aussi une primitive particulière de \(f(x)\). Pour cette raison, on précisera toujours l'existence de cette constante lors du calcul d'une primitive.

\(\begin{align*} I =\int f(x)dx = F(x)+C\end{align*}\), avec \(C \in \mathbb R \)

Nous allons voir dans les sous chapitres les règles d'intégration (calcul de primitive) essentielles.

Intégrale de GAUSS

- Introduction

- par changement de repère

- par changement de variable

- par technique de Feyman (introduire un paramètre)

- calcul 1

- calcul2

- Généralisation: \(\begin{align*}I = \int_{-\infty}^{+\infty}e^{ax²+bx+c}dx \end{align*}\)

Introduction

|

La fonction \(f(x) = e^{-x²}\) est appelée Loi de Distribution Normale. Sa représentation graphique (la courbe de Gauss) a une forme de cloche , ou aussi une forme de chapeau bicorne. Cette fonction est très utilisée en statistique. En pratique: par exemple pour étudier la moyenne et la répartition de la taille d'une population etc etc etc. La courbe comme la fonction sont aussi appelées "Gaussienne" . L'intégrale de Gauss se définit comme étant: \[\begin{align*} I = \int_{-\infty}^{+\infty} e^{-x²}dx\end{align*}\]

|

Avec les coordonnés polaires

| \(\begin{align*} I = \int_{-\infty}^{+\infty} e^{-x²}dx\end{align*}\). Dans cette intégrale, on dit que \(x\) est une variable muette. On peut la remplacer par toute autre variable. On a donc :

\(\begin{align*} I = \int_{-\infty}^{+\infty} e^{-x²}dx\end{align*}\), et aussi \(\begin{align*} I = \int_{-\infty}^{+\infty} e^{-y²}dy\end{align*}\) On peut donc calculer \(I \times I\) en considérant ces 2 dernières expressions de \(I\): On peut à présent utiliser les différentes propriétés des intégrales: On se retrouve en présence de \(x²+y²\) ce qui doit nous faire penser immédiatement à l'équation d'un cercle. Procédons à un changement de coordonnées pour passer en coordonnées polaires. \(\begin{align*}\begin{cases} x \in ]-\infty;+\infty[ \\ y \in [-\infty;+\infty[ \end{cases} \Rightarrow \begin{cases} r \in [0;+\infty[ \\ \theta \in [0;2\pi[ \end{cases} \end{align*}\) \(dx.dy=det[\mathbb J(r;\theta)]dr.d\theta\) ou \( \mathbb J(r;\theta)\) est le Jacobien de \(r\) et \(\theta\)\(\begin{align*} det[ \mathbb J(r;\theta)] & = \begin{vmatrix}\frac{\partial x}{\partial r} & \frac{\partial x }{\partial \theta} \\ \frac{\partial y}{\partial r} & \frac{\partial y}{\partial \theta} \end{vmatrix} = \begin{vmatrix} \frac{\partial (r.cos\theta)}{\partial r} & \frac{\partial (r.cos\theta) }{\partial \theta} \\ \frac{\partial (r.sin\theta)}{\partial r} & \frac{\partial (r.sin\theta)}{\partial \theta} \end{vmatrix} \\ & = \begin{vmatrix} cos\theta & -r.sin \theta \\ sin \theta & r.cos\theta \end{vmatrix} \\ & = r.cos²\theta- (-r.sin²\theta) = r.cos²\theta+r.sin²\theta \\ & r(cos²\theta+sin²\theta)=r \\ \Rightarrow dx.dy = r.dr.d\theta \end{align*}\)

En définitive, nous avons : Procédons maintenant à un changement de variable : \(\begin{align*} I² & = 2\pi \int_{r=0}^{r=+\infty}e^{-r²} r.dr = \pi \int_{r=0}^{r=+\infty} e^{-r²} 2r. dr \\ Avec : \(\begin{align*} \begin{cases} -e^{-u} \xrightarrow{ u \rightarrow 0} -1 \\ \\ -e^{-u} \xrightarrow{u \rightarrow +\infty} 0 \end{cases}\end{align*}\) Pour finir:

Remarque: |

Avec changement de variable

|

\(\begin{align*} I = \int_{-+\infty}^{+\infty} e^{-x²}dx\end{align*}\). Dans cette intégrale, on dit que \(x\) est une variable muette. On peut la remplacer par toute autre variable. On peut donc calculer \(I \times I\) en considérant ces 2 dernières expression de \(I\): On peut à présent utiliser les différentes propriétés des intégrales:

Procédons à un changement de variable: \(y=xt\). \(\begin{align*} I² & = 4 \int_{x=0}^{x=+\infty} \bigg( \int_{t=0}^{t=+\infty} e^{-(x²+x²t²)}x.dt \bigg)dx \\ Nous pouvons intervertir l'ordre d 'intégration car cette intégrale est convergente. Attention, maintenant nous intégrons par rapport à \(x\), et \(t\) est considéré comme une constante. Procédons à un nouveau changement de variable: \(u= -x²(1+t²)\) \(\begin{align*}I² & = 4 \int_{t=0}^{t=+\infty} \bigg( \int_{x=0}^{x=+\infty} xe^{-x²(1+t²)} dx \bigg) dt \\

|

Méthode de Feynman

|

La méthode de Feynman consiste à introduire un paramètre (par exemple \(t\)) dans \(f(x)\) afin d 'obtenir une intégrale à paramètre. Marche à suivre:

Je vous propose 2 calculs différents Calcul 1

Calcul 2

|

Généralisation: \(\begin{align*} K = \int_{-\infty}^{+\infty} e^{-ax²+bx+c}dx\end{align*}\)

|

On se propose maintenant de généraliser l'intégrale de Gauss en considérant que \((-x²)\) est un polynôme du second degré. Alors il nous faut calculer : \[\begin{align*} K = \int_{-\infty}^{+\infty} e^{ax²+bx+c}dx\end{align*}\].

1 - Existence de \(I\)Soit \(P(x) = ax²+bx+c\)

\(\begin{align*} K = \int_{-\infty}^{+\infty} e^{ax²+bx+c}dx\end{align*}\) n'existe que pour \(a \lt 0\)

2 - Calcul de KOn remarque que \(I\) s'exprime avec un carré de \(x\). Nous allons donc essayer de nous rapprocher de cette forme pour calculer \(K\). Le moyen de se rapprocher de cette forme est

2-1 - Forme canonique:Soit \( P(x) = ax²+bx+c \) : Et donc: \(\begin{align*} K = e^{- \Delta/4a} \int_{-\infty}^{+\infty} e^ { a \big(x+\frac{b}{2a}\big)^2} .dx \end{align*}\)

2-2 - Changement de variable: \(u=x+\frac{b}{2a}\)\(\begin{align*} & \begin{cases} u=x+\frac{b}{2a} \\ x= u - \frac{b}{2a} \\ dx = du \end{cases} \Rightarrow \begin{cases} x \rightarrow -\infty \Rightarrow u \rightarrow -\infty \\x \rightarrow +\infty \Rightarrow u \rightarrow +\infty\ \end{cases} \\ K &= e^{- \Delta/4a} \int_{-\infty}^{+\infty} e^ { a \big(x+\frac{b}{2a}\big)^2}.dx Posons \(\begin{align*} -\alpha = a \end{align*}\) avec \(\alpha \gt 0\) pour se rapprocher encore de la forme de \(I\) \(\begin{align*} K = e^{- \Delta/4a} \int_{-\infty}^{+\infty} e^ { -\alpha u^2} du \end{align*}\) Il faudrait arriver maintenant à transformer \(-\alpha u² \) en \(-v²\)

2-3 - Changement de variable: \( v=\sqrt{\alpha} \times u\)\(\begin{align*} & \begin{cases} v= \sqrt \alpha \times u \\ u= v / \sqrt \alpha \\ du = dv/\sqrt \alpha \end{cases} \Rightarrow \begin{cases} x \rightarrow -\infty \Rightarrow u \rightarrow -\infty \\x \rightarrow +\infty \Rightarrow u \rightarrow +\infty\ \end{cases} \\ \( \begin{align*}K = \frac{e^{- \Delta/4a}}{\sqrt {-a}} \sqrt \pi \end{align*}\) avec \(a<0\) 3 - Vérification:Si on prend \(P(x)=-x²\), alors \(\begin{cases}a=-1 \\ b=0 \\ c=0 \end{cases} \), donc \(\begin{cases} a=-1 \\ \Delta =b²-4ac = 0 \end{cases}\). \(\begin{align*} K = \int_{-\infty}^{+\infty} e^{-x²}dx = \frac{e^{- \Delta/4a}}{\sqrt {-a}} \sqrt \pi = \frac{e^0}{\sqrt {-(-1)}} \sqrt \pi =\sqrt \pi \end{align*}\). Ce qui est cohérent!!

|

Les fonctions puissances

1 - Définitions

|

Pour tout \(x \in \mathbb R_+^*\), par définition de la fonction exponentielle, on a \(x=e^{lnx}\). Et d'après les propriétés usuelles de la fonction exponentielle, pour tout \(n \in \mathbb Z\), on a : \(x^n = (e^{lnx})^n = e^{n.lnx}\) Ce qui nous amène naturellement a la définition suivante: Définition:

Pour \(a \in \mathbb R\), \(\phi'a)\) est appelée fonction puissance

On notera en particulier que :

Proposition:

Proposition: |

2 - Croissances comparées

Logarithme

1 - Au Lycée

Définition 1:

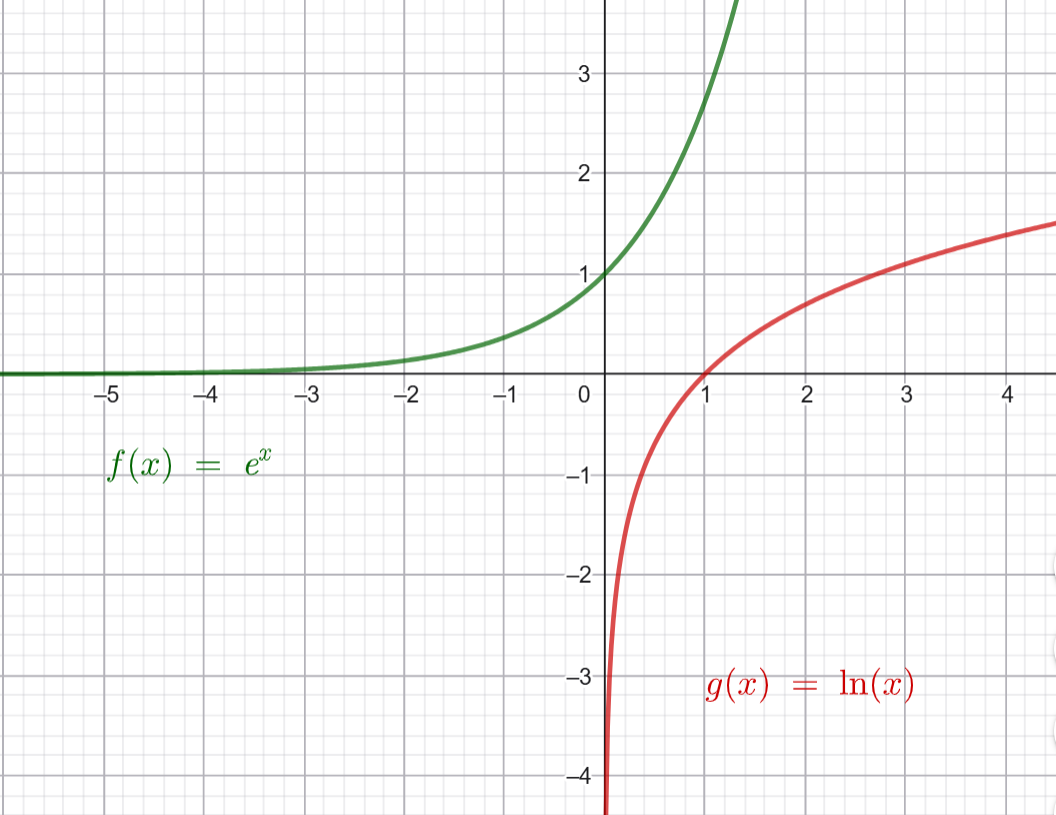

En conséquence: \(y=lnx\) et \(x \gt 0\) équivaut à \(e^y = x\) On dit que la fonction \(ln\) est la fonction réciproque de la fonction exponentielle

Représentation graphique:

Propriétés algébrique :\(\forall x \in \mathbb R_+\) et \(\forall y \in \mathbb R_+\), \(\forall k \in \mathbb Z\)

Sens de variation :

Dérivée et primitives:

Limites:

|

2 - En post bac

|

On suppose connu les propriétés suivantes:

La définition vue en post bac est quelque peu différente. Définition:

Proposition:

Proposition:

|